نشر أحد حسابات منصة فيسبوك الادعاء بتاريخ 7 مارس 2026، مرفقًا بالنص الوصفي على الفيديو -دون تصرف-:

#فيديو_متداول #إسرائيل.

فيديو متداول يقال أنه استهداف إيراني لمبنى في تل أبيب ولقي 200 شخص حتفهم

#الحرب_الإسرائيلية_الأمريكية_الإيرانية

حصد الفيديو 23 مشاركة، وتداولته حسابات اخرى هنا، وهنا.

إثر ذلك أجرى فريق “فتبينوا” تحريًا حول حقيقة الادعاء المتداول، فأسفر عن الآتي:

هذا الفيديو مُولد بالذكاء الاصطناعي وليس من الهجوم الإيراني على تل ابيب مؤخرًا

بحسب وكالة الأنباء رويترز -دون تصرّف-: تبادلت إسرائيل وإيران المزيد من الهجمات اليوم السبت مع دخول الحرب أسبوعها الثاني، وقدم الرئيس الإيراني اعتذارا للدول المجاورة في محاولة لتهدئة الغضب في منطقة الخليج، لكنه تعرض لانتقادات من غلاة المحافظين في الداخل.

وفي السياق ذاته، أفادت وكالة فرانس برس بأن الضربات الصاروخية الإيرانية استمرت على تل ابيب حتى وقت كتابة هذا المقال يوم الاثنين 9 مارس

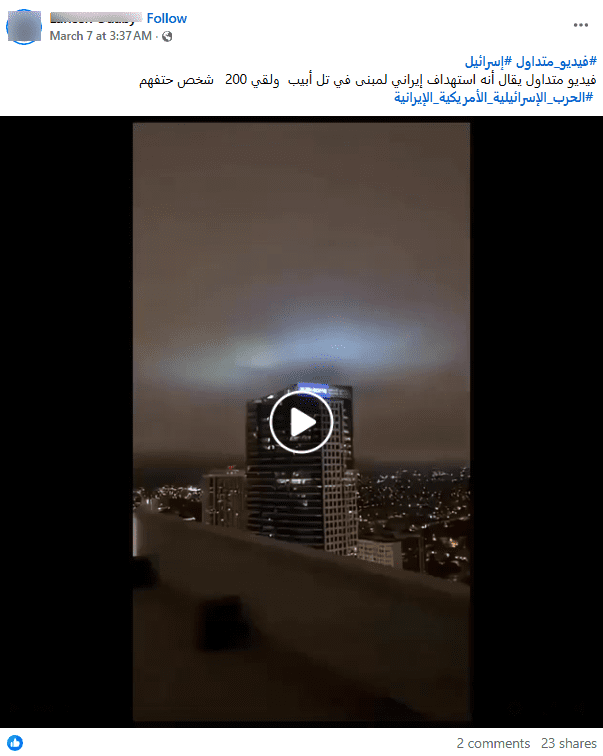

في هذا السياق تداول ناشطون على منصات التواصل الاجتماعي مقطع فيديو يدّعون أنه يصور مشاهد من لحظة انهيار مبنى في تل ابيب بعد سقوط صاروخ إيراني عليه. إلا أن التحري الذي أجراه فريق منصة «فتبينوا» كشف أن هذا الادعاء غير صحيح.

من خلال التدقيق في الفيديو، يمكن رصد العديد من التشوّهات والمؤشرات غير المنطقية التي تؤكد أنه ليس تسجيلًا حقيقيًا، بل مُولد بالذكاء الاصطناعي، ومن أبرزها:

- معرفة مصوّر الفيديو المسبقة بوقوع الانفجار، إذ يبدو أنه كان يوجه الكاميرا نحو المبنى قبل لحظة سقوط الصاروخ مباشرة، وهو أمر غير معتاد في حوادث القصف الحقيقية

- انهيار المبنى بسرعة غير طبيعية، حيث ينهار بالكامل خلال جزء من الثانية، على خلاف ما يحدث عادة في حالات قصف المباني التي يستغرق انهيارها وقتًا أطول

- كمية الدخان والغبار محدودة ولا تتناسب مع مشاهد موثقة لانهيار مبانٍ أو قصفها، إذ تكون سحب الغبار في الواقع كثيفة وتنتشر بسرعة في محيط موقع القصف

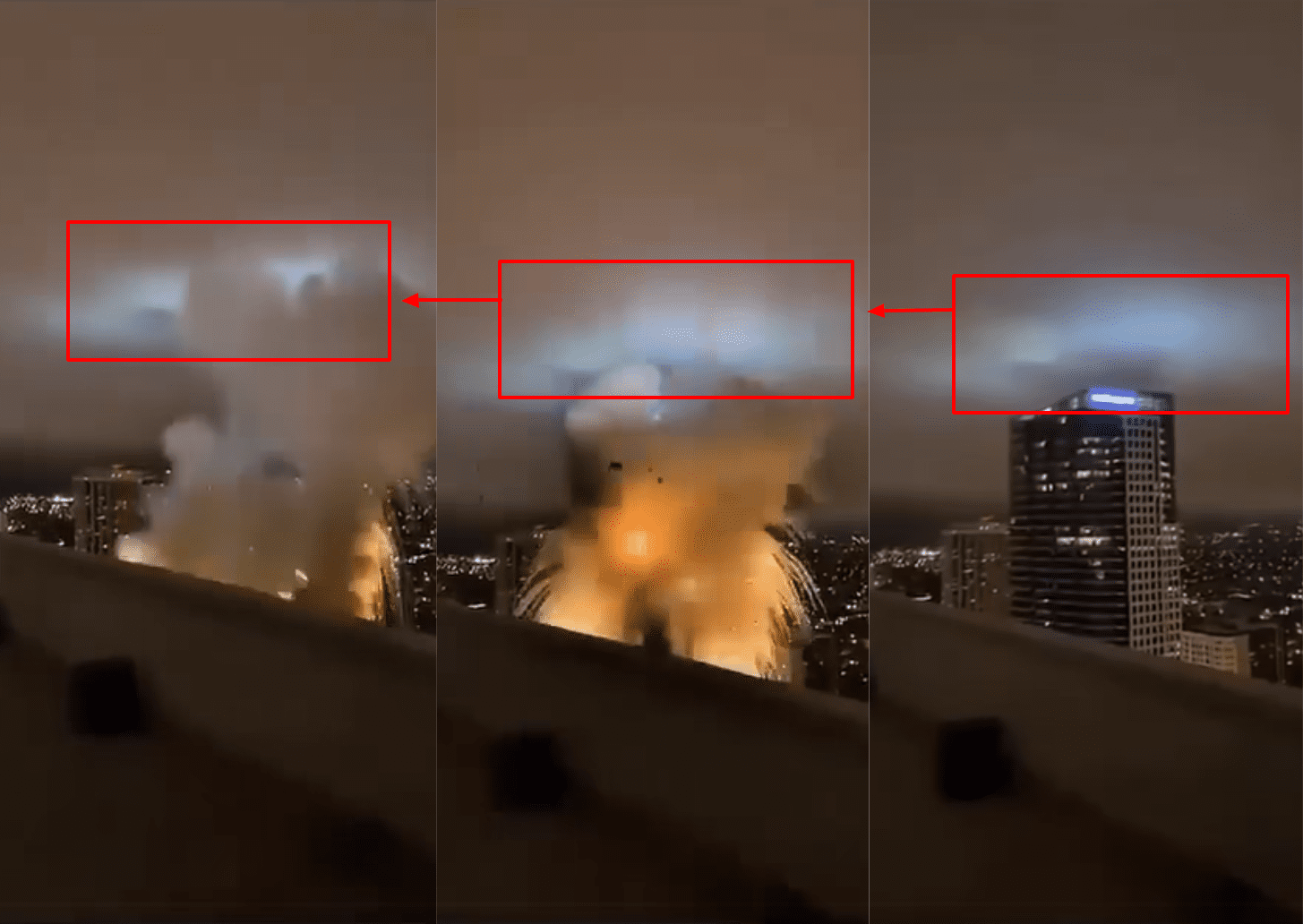

- استمرار ظهور ضوء شعار المبنى منعكسًا على الغيوم فوق الموقع حتى بعد انهيار المبنى، ما يشير إلى خلل في توليد المشهد رقميًا

- عدم وجود أي تقارير إعلامية موثوقة تشير إلى انهيار مبانٍ في تل أبيب بهذا الشكل، رغم التغطية الواسعة للهجمات الإيرانية

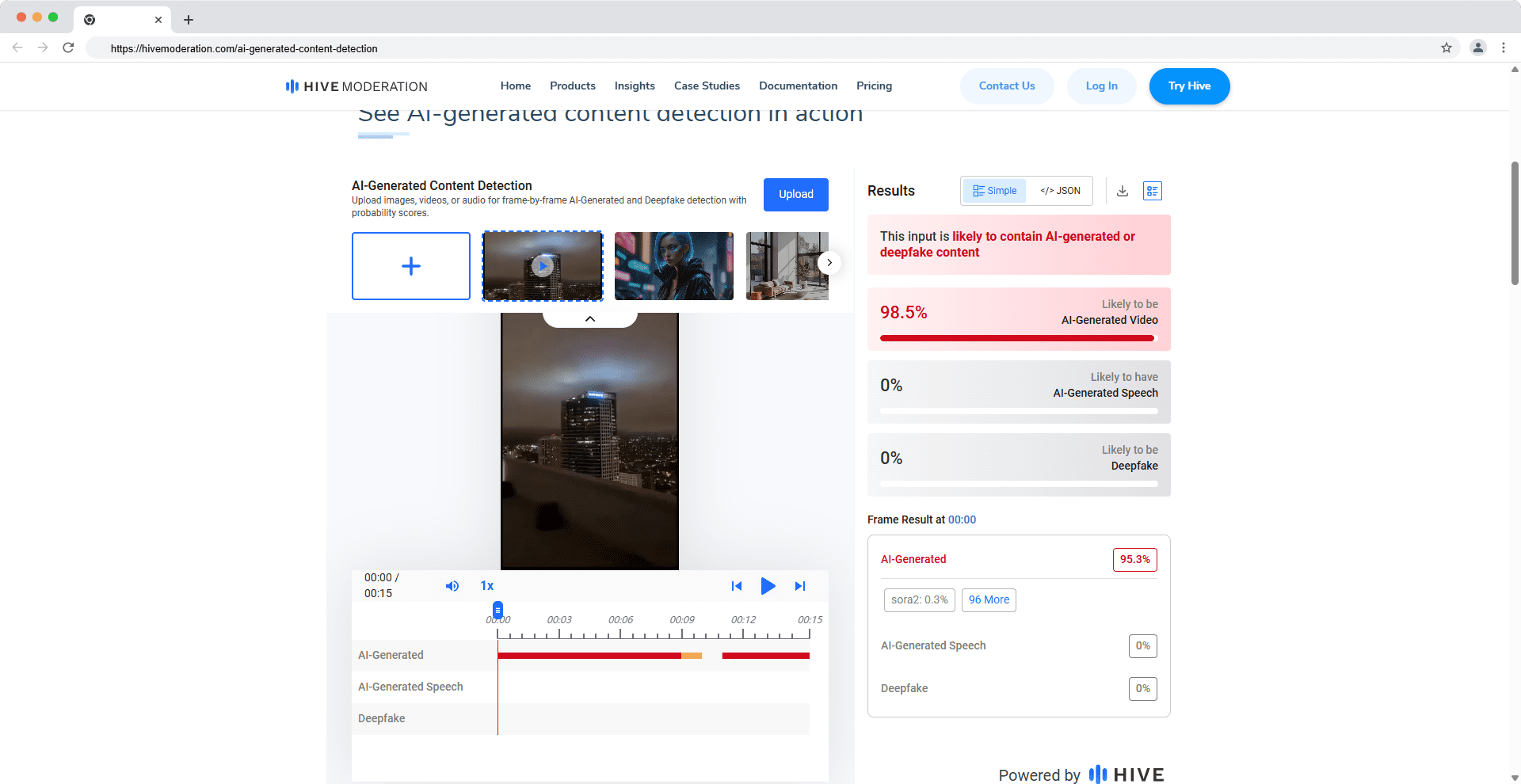

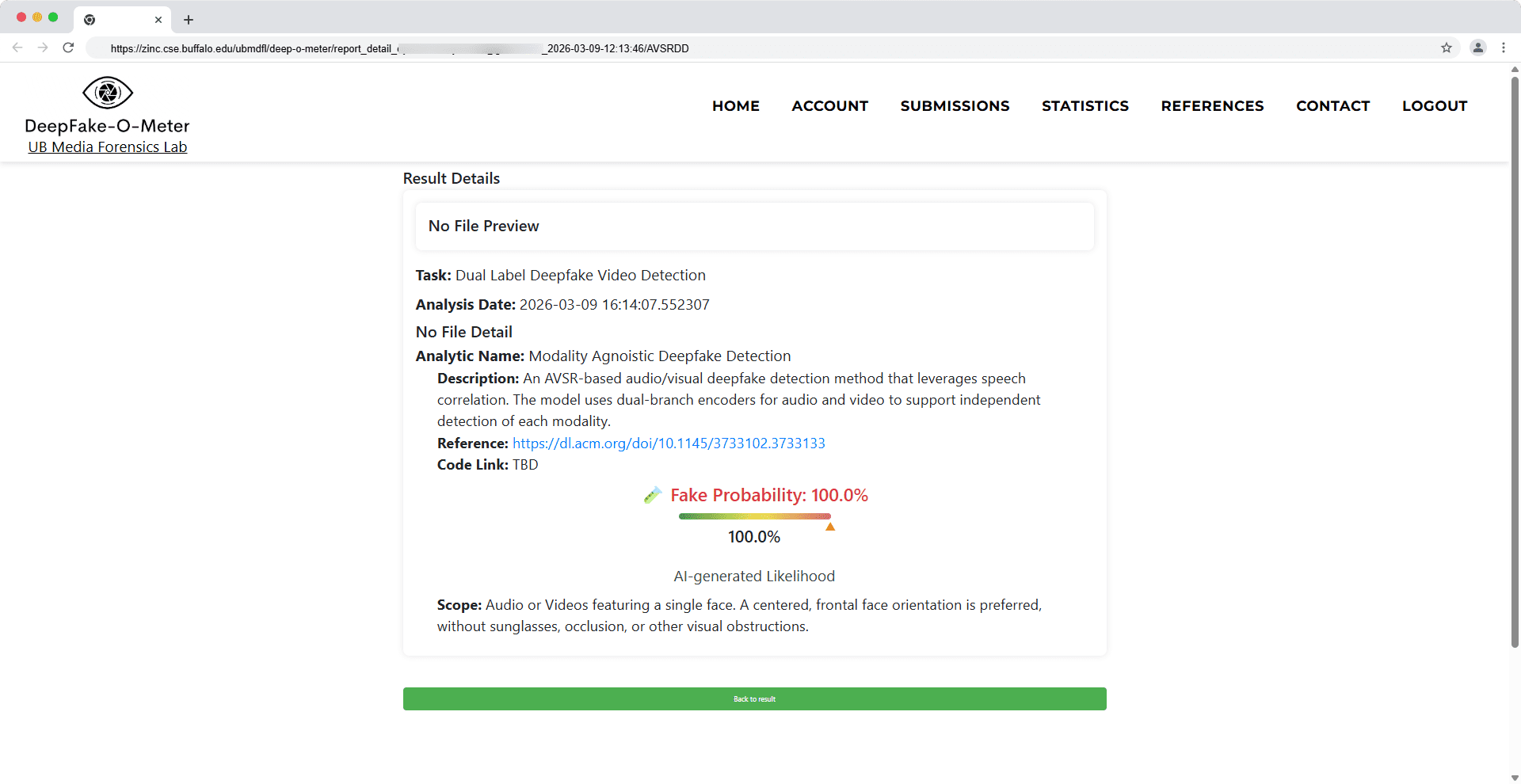

وبعد ادخال الفيديو لفحص تقني عبر أداة DeepFake-o-Meter التابعة لـUniversity at Buffalo، والتي تجمع نتائج عدة نماذج متخصصة في كشف المقاطع المولّدة بالذكاء الاصطناعي مثل FTCN وWAV2LIP-STA وMADD، بالاضافة إلى نموذج المطور من قبل hivemoderation، أظهرت النتائج أن احتمال توليد الفيديو بالذكاء الاصطناعي مرتفع للغاية، إذ وصلت في بعض المؤشرات نسبة 100%.